Sempre più AI nelle imprese: come limitare problemi etici o sociali

L’uso dell'intelligenza artificiale da parte delle imprese continua a crescere in molti settori – dalla finanza, alla sanità, all'industria dell'automobile. Diventa quindi urgente l’adozione di prassi responsabili per limitare le potenziali ripercussioni di natura etica, come i rischi relativi alle violazioni della privacy.

L'intelligenza artificiale (AI) ha drasticamente trasformato l'ambiente imprenditoriale e si è affermata come elemento cruciale per le imprese in una vasta gamma di settori – dalla finanza, alla sanità, all'industria dell'auto.

I sistemi di AI hanno fatto molta strada dalla loro prima comparsa, e oggi sono in grado di combinare tra loro gruppi di dati complessi e tecnologia informatica, simulando capacità decisionali e di problem-solving di tipo umano. L'AI offre anche molte applicazioni nel mondo reale, dall'automazione dell’assistenza al cliente all'ottimizzazione dei servizi o delle prestazioni dei prodotti.

L'adozione di tecniche di AI è in costante crescita. Da un'indagine di McKinsey risulta che, delle oltre 1.800 organizzazioni consultate, il 56% ha adottato sistemi di intelligenza artificiale nel 2021 – a fronte del 50% del 2020. Dall'indagine è inoltre emersa una crescita del numero di partecipanti che attribuiscono almeno il 5% dell'utile operativo netto (EBIT) all'AI, in rialzo al 27% dal 22% dell'anno precedente.

Anche uno studio analogo condotto da Gartner nel 2022 ha rilevato un crescente ricorso all'AI da parte delle imprese. Il 40% delle organizzazioni oggetto dell'indagine aveva introdotto migliaia di modelli di AI, facendo prevedere che il valore commerciale dell'intelligenza artificiale possa arrivare a 5,1 miliardi di dollari entro il 2025.

Tuttavia, poiché l'uso dell'intelligenza artificiale da parte delle imprese continua a crescere, sarà estremamente importante adottare prassi responsabili per mantenere questo tasso di crescita, limitando le potenziali ripercussioni di natura etica e sociotecnica.

In qualità di società d'investimento globale con sostanziosi investimenti nel settore tecnologico, riteniamo di poter avere un ruolo positivo d’incoraggiamento per un'AI responsabile. La nostra ricerca mira a definirne i principi fondanti, e cerca di comprendere come possano essere messi in pratica con un orizzonte di lungo termine.

Rischi e opportunità dell'AI

Considerando il valore reale che le aziende possono trarre dai sistemi di AI, essi rappresentano potenziali opportunità di rendimento a tutto vantaggio dei nostri clienti. L'intelligenza artificiale è alla base del metaverso, di cui consente la scalabilità e l'automazione1 – grazie a funzioni di deep learning e alla tecnologia NLP (Natural Language Processing), che potenziano le attività e le interazioni sul Web 3.0.2

L'AI, unita al metaverso, potrà a nostro avviso aprire maggiori opportunità d'investimento, alimentate da imprese in grado di generare una solida crescita a/a nei prossimi dieci anni.

Dal punto di vista ambientale, sociale e di governance (ESG), l'AI dovrebbe consentire agli investitori di raccogliere e analizzare informazioni su rischi e opportunità in quantità senza precedenti. In particolare, vediamo un grande potenziale nell'uso degli algoritmi per l'analisi del sentiment e nelle soluzioni NLP per migliorare l'integrazione dei fattori ESG nelle strategie d'investimento.3

In AXA IM abbiamo sviluppato una tecnica proprietaria di Impact investing NLP-enabled, che attribuisce un punteggio a sezioni di documenti societari per contribuire a valutare l'allineamento delle imprese agli Obiettivi per lo sviluppo sostenibile delle Nazioni Unite (SDG).

Un altro studio ha invece dimostrato come l'AI possa dare un contributo netto al raggiungimento dei 169 target specifici all'interno dei 17 SDG generali. Tra i possibili esempi figurano una tecnologia in grado di ottimizzare l'identificazione dei materiali riciclabili per ridurre la presenza di plastica nei mari, o una piattaforma che utilizza dati satellitari e intelligenza artificiale per ridurre lo spreco idrico.

Tuttavia, accanto alle opportunità e alle potenziali applicazioni che possono offrire, i sistemi di AI comportano anche rischi devastanti – tra i più evidenti, quelli relativi alle violazioni della privacy e i cyberattacchi, capaci di danneggiare in pochissimo tempo la reputazione di un'azienda.

L'intelligenza artificiale comporta anche rischi a livello umano e sociale che, per quanto più difficili da definire e quantificare, sono innegabilmente i più salienti. Per esempio, i sistemi di AI possono costituire una fonte di discriminazione. A livello di servizi finanziari, la “discriminazione di rete” può svantaggiare alcune comunità rispetto all'accesso al credito; se applicata alla selezione del personale, può riprodurre schemi esistenti di distorsione sociale.

Rispetto all'uso dell'AI per moderare i contenuti, la loro segnalazione automatica può dare luogo a violazioni del diritto di libera opinione e di libera espressione – per non parlare delle questioni di ordine giuridico ed etico connesse alla capacità di questi strumenti di identificare e controllare le persone.

Regolamentazione: un contesto nascente

In considerazione dei notevoli rischi associati all'adozione dell'AI, assistiamo alla nascita di un nuovo ambiente normativo. L'Unione europea è al lavoro su una bozza di regolamento che riprende i contenuti del GDPR,4 e che mira ad affrontare i rischi connessi a specifiche applicazioni dell'intelligenza artificiale, assicurando una maggiore affidabilità dei sistemi utilizzati.

Il GDPR classifica i sistemi di AI in base a tre categorie di rischio, prevedendo per ognuna le azioni da intraprendere:

Categorie di rischio dell’UE per i sistemi di AI:

| Sistemi di AI con livello di rischio inaccettabile |

Sistemi di AI ad alto rischio |

Sistemi di AI a rischio minimo e limitato |

|---|

Fonte: McKinsey & Co. What the draft European Union AI regulations mean for business, 2021: Relevance of AI risks for companies.

Stando alla bozza di regolamento, non dovrebbe più essere consentito l'utilizzo di sistemi con livello di rischio inaccettabile all'interno dell'UE; i sistemi ad alto rischio dovrebbero essere soggetti a una serie di requisiti, tra i quali la supervisione umana, la trasparenza, la cybersicurezza, la gestione del rischio, la qualità dei dati, il monitoraggio e l'obbligo di reporting; e dovrebbero essere introdotti obblighi di trasparenza in caso di utilizzo di sistemi a rischio minimo e limitato, mettendo gli utenti a conoscenza del fatto che stanno interagendo con tecnologie di AI.

Il regolamento non riguarderebbe soltanto società e fornitori di servizi di AI all'interno dell'Unione, ma sarebbe applicabile anche al di fuori di questo territorio su qualsiasi sistema di intelligenza artificiale i cui risultati siano fruibili entro i confini UE. Le società che violeranno queste disposizioni saranno sanzionabili fino a un massimo del valore più alto tra 30 milioni di euro e il 6% del loro fatturato globale – sanzioni ben più sostanziose di quelle imposte dal GDPR.

A fronte della crescente attenzione di governi ed enti regolatori di tutto il mondo circa la regolamentazione e la gestione dell'AI, le società potranno essere esposte a rischi molto consistenti, sia a livello legale che finanziario.

Approcci responsabili all'AI

Al di là della regolamentazione, la Commissione europea ha pubblicato un documento dal titolo "Ethics Guidelines for Trustworthy AI" che potrà essere un utile riferimento per le imprese rispetto all'implementazione di pratiche di AI responsabile. Questi orientamenti cercano di favorire un'intelligenza artificiale lecita, etica e solida rispetto ai possibili danni che potrebbe causare.

Vi si fa riferimento a principi etici che si traducono in requisiti concreti per le imprese:

- Rispetto dell'autonomia umana: Assicurare il rispetto della libertà e dell'autonomia dell'essere umano; ripartizione di funzioni tra esseri umani e sistemi di AI conforme a principi costruttivi che pongano l'uomo al centro e lascino ampio spazio alla scelta umana; mantenere la sorveglianza umana sui processi di lavoro dei sistemi di AI.

- Prevenzione dei danni: I sistemi di AI non devono causare o esacerbare i danni, né avere impatti negativi sull'essere umano; occorre anche prestare attenzione a situazioni in cui i sistemi di AI potrebbero avere o esacerbare impatti negativi a causa di asimmetrie di potere o di informazione; la dignità umana e l'integrità fisica e mentale devono essere tutelate.

- Equità: Assicurare un'equa e giusta distribuzione di costi e benefici, affinché singoli e gruppi di individui siano liberi da ingiusti condizionamenti, da discriminazioni e stigmatizzazioni; che l'uso dei sistemi di AI non inganni le persone o non pregiudichi ingiustificatamente la loro libertà di scelta; deve essere tutelata la possibilità di contestare e di ottenere un'efficace riparazione in caso di decisioni prese dai sistemi di AI e dagli addetti umani preposti al loro utilizzo.

- Spiegabilità: I processi devono essere trasparenti, le funzioni e il fine dei sistemi di AI devono essere comunicati in modo esplicito, e le decisioni devono poter essere spiegate a coloro che ne siano, direttamente o indirettamente, colpiti; devono essere evitati gli algoritmi a effetto “scatola nera”.

L'approccio all'AI responsabile di AXA IM utilizza una struttura simile che prevede quattro chiare componenti. Siamo convinti che i sistemi di intelligenza artificiale debbano essere equi, etici e trasparenti, senza rinunciare alla sorveglianza umana – sia a livello tecnico che nella prospettiva di una governance di alto livello.

Se rispetteranno le politiche di AI responsabile, le aziende saranno in grado di mitigare gli effetti dei rischi connessi all'intelligenza artificiale e riusciranno a generare valore sostenibile – potranno così cogliere i vantaggi dello sviluppo di sistemi di AI, conquistandosi la fiducia e la fedeltà dei clienti.

In conclusione, l'AI responsabile non si limita a evitare i rischi, bensì può sfruttare queste tecnologie a vantaggio sia delle persone che delle imprese.

Come viene implementata l'AI responsabile

Abbiamo passato in rassegna numerosi studi e benchmark/strumenti di valutazione che esaminano come le imprese gestiscono e implementano sistemi di AI responsabile – e ci siamo resi conto che ci sono enormi differenze in termini di progressi compiuti.

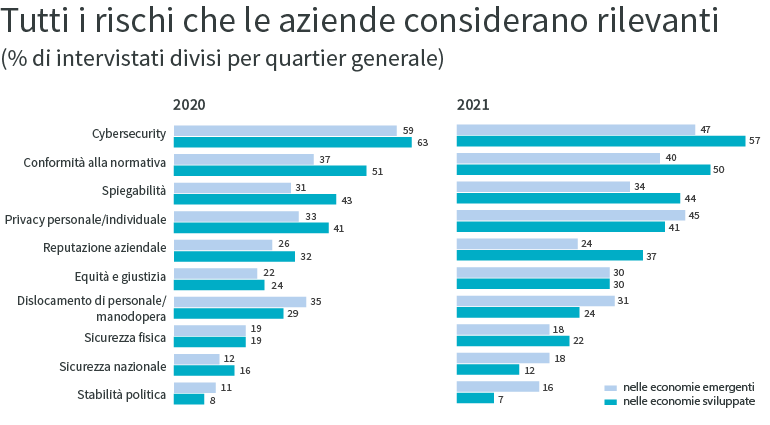

Il sondaggio effettuato nel 2021 da McKinsey, per esempio, mette in luce quella che consideriamo una mancanza di consapevolezza delle organizzazioni consultate sui diversi rischi connessi all'AI. Il grafico riportato di seguito ci sembra un buon esempio di come le aziende sottovalutino i rischi.

Fonte: McKinsey & Co. The state of AI in 2021, 2021: Relevance of AI risks for companies.

Allo stesso modo, la 2022 Big Tech Scorecard by Ranking Digital Rights (RDR), un programma di ricerca indipendente, ha dato un giudizio piuttosto negativo alle società tecnologiche rispetto alla trasparenza degli algoritmi – sulla base di indicatori che rispecchiano un sistema di riferimento analogo a quello appena illustrato, comprendente elementi relativi alle politiche sui diritti umani nello sviluppo dei sistemi basati su algoritmi, alle valutazioni dei rischi, alla trasparenza e alla riservatezza dei dati.

Nessuna delle grandi società tecnologiche valutate ha ottenuto un punteggio superiore al 22%, in base alla metodologia utilizzata da RDR, con alcuni colossi globali relegati verso il fondo della classifica.

Il Digital Inclusion Benchmark della World Benchmarking Alliance ha invece stilato una classifica delle imprese in base alla presenza di una “ricerca e sviluppo inclusiva ed etica” e ha cercato di capire “fino a che punto le prassi di una società rispecchiano la partecipazione di diversi gruppi e la presenza di considerazioni etiche nello sviluppo prodotti”. La nostra valutazione dei punteggi di riferimento di diverse società ha rilevato performance deludenti, e solo il 3% delle 77 imprese oggetto dello studio ha ottenuto un punteggio alto.

Questi risultati a nostro parere contribuiscono a dimostrare la necessità di investitori responsabili per coinvolgere le imprese in un dibattito sull'AI responsabile e su come sia possibile metterla in pratica. Nel contesto della nostra ricerca sulle tecnologie responsabili e del nostro programma di engagement, ad AXA IM ci concentriamo su aziende con importanti piani d'investimento finalizzati allo sviluppo dell'AI.

Le nostre principali raccomandazioni alle imprese sono di:

- mettersi in linea con le principali componenti dell'approccio di AI responsabile di AXA IM – equità, eticità, trasparenza, presenza della sorveglianza umana;

- migliorare l'informativa e la trasparenza sullo sviluppo di sistemi di AI;

- assicurare la vigilanza dei vertici societari e del consiglio di amministrazione sull'AI responsabile.

La mitigazione dei rischi associati ai sistemi di intelligenza artificiale – tenendo conto anche dei requisiti normativi – è strettamente correlata alla capacità delle imprese di assicurare la creazione di valore a lungo termine attraverso queste tecnologie. Crediamo inoltre che i sistemi di AI abbiano maggiori possibilità di offrire più opportunità sostenibili a lungo termine se si rispettano criteri di AI responsabile.

- The Metaverse: Driven By AI, Along With The Old Fashioned Kind Of Intelligence – Forbes, 2022.

- Il Web 3.0 è un'idea in evoluzione per l'internet di terza generazione, che integra concetti di decentralizzazione e nuove tecnologie blockchain per ottimizzare gli applicativi web. Con Web 1.0 si fa riferimento ai primi periodi di internet fino al 2004 circa, mentre il Web 2.0 indica il passaggio a contenuti generati dagli utenti attraverso hub centralizzati.

- Il Natural Language Processing (NLP) è una branca dell'informatica e dell'AI che consente alle macchine di elaborare grandi volumi di documenti scritti e di analizzarne, estrarne e utilizzarne il contenuto con grande rapidità. Tra gli impieghi più comuni figurano le tecniche di autocorrezione e l'analisi del sentiment in tempo reale.

- Il regolamento generale sulla protezione dei dati dell'UE (GDPR) è una raccolta di norme sulla protezione e la riservatezza dei dati personali introdotta nel 2018, che vuole assicurare al cittadino una maggiore possibilità di controllo sulle informazioni che lo riguardano.

Disclaimer

AXA IM e BNP Paribas Asset Management stanno progressivamente fondendo e semplificando le loro entità legali per creare una struttura unificata. AXA Investment Managers è entrata a far parte del Gruppo BNP Paribas nel luglio 2025. A seguito della fusione di AXA Investment Managers Paris e BNP Paribas Asset Management Europe e delle rispettive holding, avvenuta il 31 dicembre 2025, le società combinate operano ora sotto il marchio BNP Paribas Asset Management Europe.

Prima dell’investimento in qualsiasi fondo gestito o promosso da BNP Paribas Asset Management o dalle società ad essa affiliate, si prega di consultare il Prospetto e il Documento contenente le informazioni chiave (KID). Tali documenti, che descrivono anche i diritti degli investitori, possono essere consultati - per i fondi commercializzati in Italia - in qualsiasi momento, gratuitamente, sul sito internet www.axa-im.it e possono essere ottenuti gratuitamente, su richiesta, presso la sede di BNP Paribas Asset Management. Il Prospetto è disponibile in lingua italiana e in lingua inglese. Il KID è disponibile nella lingua ufficiale locale del paese di distribuzione.

I contenuti pubblicati nel presente sito internet hanno finalità informativa e non vanno intesi come ricerca in materia di investimenti o analisi su strumenti finanziari ai sensi della Direttiva MiFID II (2014/65/UE), raccomandazione, offerta, anche fuori sede, o sollecitazione all’acquisto, alla sottoscrizione o alla vendita di strumenti finanziari o alla partecipazione a strategie commerciali da parte di BNP Paribas Asset Management o di società ad essa affiliate. L’investimento in qualsiasi fondo gestito o promosso da BNP Paribas Asset Management o dalle società ad essa affiliate è accettato soltanto se proveniente da investitori che siano in possesso dei requisiti richiesti ai sensi del prospetto informativo in vigore e della relativa documentazione di offerta.

Il presente sito contiene informazioni parziali e le stime, le previsioni e i pareri qui espressi possono essere interpretati soggettivamente. Le informazioni fornite all’interno del presente sito non tengono conto degli obiettivi d’investimento individuali, della situazione finanziaria o di particolari bisogni del singolo utente. Qualsiasi opinione espressa nel presente sito internet non è una dichiarazione di fatto e non costituisce una consulenza di investimento. Le previsioni, le proiezioni o gli obiettivi sono solo indicativi e non sono garantiti in alcun modo. I rendimenti passati non sono indicativi di quelli futuri. Il valore degli investimenti e il reddito da essi derivante possono variare, sia in aumento che in diminuzione, e gli investitori potrebbero non recuperare l’importo originariamente investito.

Ancorché BNP Paribas Asset Management impieghi ogni ragionevole sforzo per far sì che le informazioni contenute nel presente sito internet siano aggiornate ed accurate alla data di pubblicazione, non viene rilasciata alcuna garanzia in ordine all’accuratezza, affidabilità o completezza delle informazioni ivi fornite. BNP Paribas Asset Management declina espressamente ogni responsabilità in ordine ad eventuali perdite derivanti, direttamente od indirettamente, dall’utilizzo, in qualsiasi forma e per qualsiasi finalità, delle informazioni e dei dati presenti sul sito.

BNP Paribas Asset Management non è responsabile dell’accuratezza dei contenuti di altri siti internet eventualmente collegati a questo sito. L’esistenza di un collegamento ad un altro sito non implica approvazione da parte di BNP Paribas Asset Management delle informazioni ivi fornite. Il contenuto del presente sito, ivi inclusi i dati, le informazioni, i grafici, i documenti, le immagini, i loghi e il nome del dominio, è di proprietà esclusiva di BNP Paribas Asset Management e, salvo diversa specificazione, è coperto da copyright e protetto da ogni altra regolamentazione inerente alla proprietà intellettuale. In nessun caso è consentita la copia, riproduzione o diffusione delle informazioni contenute nel presente sito.

BNP Paribas Asset Management può decidere di porre fine alle disposizioni adottate per la commercializzazione dei suoi organismi di investimento collettivo in conformità a quanto previsto dall'articolo 93 bis della direttiva 2009/65/CE.

BNP Paribas Asset Management si riserva il diritto di aggiornare o rivedere il contenuto del presente sito internet senza preavviso.

Redatto da BNP Paribas Asset Management Europe. © BNP Paribas Asset Management 2026. Tutti i diritti riservati.